ژوره زده کړه

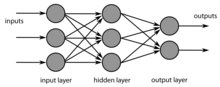

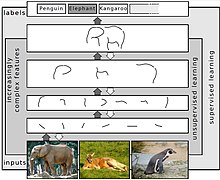

ژوره زده کړه ، ژور لوستنه يا(انګلیسي: Deep learning) د ژور جوړښت زده کړه یا هراړخیز زده کړه ) د ماشین زده کړې فرعي څانګه ده ده چې د الګوريتمونو په اساس هڅه کوي چې په ډیټا کې د لوړې کچې هغه خلاصې مفکورې ماډل کړي چې دا پروسه يې کاروي. یو ژور ګراف ماډل کړي چې د پروسس کولو څو پرتونه لري چې د خطي او غیر خطي بدلونونو څو پرتونو څخه جوړ دي. په بل عبارت، دا د زده کړې، د پوهې استازيتوب او د ماډل دننيو ځانګړتياوو پربنسټ کار کوي [۱] په بل عبارت، "ژوره زده کړه" د څو پرتونو عصبي شبکې سره د "ماشین زده کړې"يو ډول دی چې په ډيټا کې نمونې د زیاتېدونکي دقیقیت سره کشف کوي او له همدې امله کولی شي د کارونکي ګټې وپیژني، شیان پیژني او په ژبو پوه شي. [۲] د روزنې بېلګه (د مثال په توګه: د پیشو عکس) په بېلابېلو لارو نمونه کېدای شي، د رياضيکي ويکتور په توګه چې د هر پکسل لپاره د ارزښتونو څخه ډک وي او په عمومي ډول د کوچنیو فرعي شکلونو سیټ (لکه د پیشو هرې برخې مخ). د دې ماډل کولو ځينې تګلارې د ماشين زده کړې پروسه ساده کوي (د مثال په توګه: د پیشو انځور پېژندنه). په ژوره زده کړه کې، امید شتون لري چې د دې انځور ځانګړتیاوو (لکه د پیشو غړو) د انسان لاس استخراج په بشپړ ډول اتوماتیک غیر څارل شوي او نیمه څارل شوي میتودونو سره بدل کړي. [۳] د دې زده کړې جوړښت رامینځته کولو لپاره لومړی انګېزه د انسان دماغ کې د عصبي جوړښت معاينه کولو نه الهام اخيستی ، چیرې چې عصبي حجرې د پوهیدو وړ کولو لپاره یو بل ته پیغامونه لیږي. [۴] د دې عصبي حجرو د نښلولو لارې په اړه د مختلفو انګیرنو پر بنسټ، په دې برخه کې بېلابېل ماډلونه او جوړښتونه وړاندې شوي او څېړل شوي دي، که څه هم دا ماډلونه په طبيعي توګه د انسان په مغزو کې نشته او د انسان دماغ ډېرې پېچلتياوې لري. دا ماډلونه لکه ژور عصبي شبکه ، د عصبي عصبي شبکه ، د ژور باور شبکه او څو نور مثالونه؛ دوی د طبیعي ژبې پروسس کولو او د عکس پروسس کولو په برخو کې ښه پرمختګ کړی دی. په حقیقت کې، د ژورې زده کړې اصطلاح د مصنوعي عصبي شبکو لپاره د نويو مېتودونو مطالعه ده. [۵] [۶] تړلې سکالوګانې[سمول]ژوره زده کړه د ماشین زده کړې الګوریتمونو ټولګه ده [۷] کوم چې د خام ننوت څخه د لوړې کچې ځانګړتیاوې استخراجوي. په بل عبارت، د ماشین زده کړې تخنیکونو یوه کټګورۍ چې د مالوماتو پروسس کولو څو پرتونه کاروي، په ځانګړې توګه غیر خطي معلومات، د څارنې یا غیر څارل شوي ځانګړتیاوو بدلولو یا استخراج لپاره، په عمومي توګه د نمونې تحلیل یا پیژندنې ، طبقه بندي، کلستر کولو هدف لپاره. [۸] د بېلګې په توګه، د انځور پروسس کولو کې، ټیټ پرتونونه ممکن څنډې کشف کړي، په داسې حال کې چې لوړ پرتونونه ممکن د انسانانو لپاره ډېرې مانا لرونکې ځانګړتیاوې ومومي، لکه لیکونه یا مخونه.  بهرنۍ لینک[سمول]ژوره زده کړه د ماشین زده کړې یوه فرعي ساحه ده چې د سینسري سیګنالونو لکه آډیو او ویډیو پروسس کولو لپاره د خطي بدلونونو ډېری پرتونونه کاروي، په دې توګه ماشين هر پېچلی مفهوم په ساده مفکورو وېشي او په دوام يې، دا هغه بنسټیزو مفکورو ته رسیږي چې د پرېکړې کولو توان لري، او پدې توګه د اړتیاوو د ټاکلو لپاره بشپړ بشري څارنې ته اړتیا نشته. په هر وخت کې د ماشین معلومات. یوه مسله چې په ژوره زده کړه کې خورا مهمه ده د معلوماتو وړاندې کولو څرنګوالی دی. ماشین ته د معلوماتو ورکول باید په داسې ډول وي چې ماشین په لنډ وخت کې اړين مالومات ترسره کړي، چې د دوی په اساس پرېکړه وکړي، کله چې د ژورې زده کړې الګوریتم ډیزاین کړئ، موږ باید د بدلون فکتورونو ته پام وکړو چې د لیدل شوي معلوماتو تشریح کوي، دا فکتورونه معمولا د لیدلو وړ فکتورونه ندي، بلکه هغه فکتورونه دي چې د لیدلو وړ کټګورۍ باندې اغیزه لري یا د ساده کولو لپاره د انسان ذهني جوړښت څخه زیږیدلی. مسلې شته. د مثال په توګه، د وینا پروسس کولو په جریان کې، د بدلون عوامل کیدای شي د وینا کونکي تلفظ، عمر یا جنسیت وي. کله چې د موټر عکس پروسس کول، د لمر اندازه د بدلون فکتور دی. د مصنوعي استخباراتو یوه ستونزه په ترلاسه شوي معلوماتو کې د بدلون فکتورونو لوی نفوذ دی. د مثال په توګه، د شپې لخوا د سور موټر څخه ترلاسه شوي ډیری پکسلونه کیدای شي تور ښکاري. د دې ستونزو د حل لپاره، ځینې وختونه موږ د معلوماتو لوړ پوهه (د انسانانو په حدودو کې) ته اړتیا لرو، او په حقیقت کې، ځینې وختونه د معلوماتو ښودلو لپاره د سمې لارې موندل یو ستونزمن او د وخت ضایع کول دي. تاریخ[سمول]د څارنې، ژورې، فیډفورډ ملټي لییر پرسیپټرونونو لپاره د عملي زده کړې لومړی الګوریتم په 1960 کې د الیکسي ایواخینکو لخوا خپور شو - چې د "ژورې زده کړې پلار" په نوم پیژندل کیږي - او ویلنټین لاپا. [۱۰] په 1971 کې، یوې مقالې د اتو پرتونو سره یوه ژوره شبکه تشریح کړه چې د زده کړې عملیات یې د ډیټا مدیریت ګروپ میتود (GMDH) سره ترسره کړل. [۱۱] نورې ژورې زده کړې معمارۍ، په ځانګړې توګه هغه چې د کمپیوټر لید لپاره جوړ شوي، په 1980 کې د نیوکوګنیترون سره پیل شوي چې د Kunihiko Fukushima لخوا معرفي شوي. [۱۲] د ژورې زده کړې اصطلاح د لومړي ځل لپاره په 1986 کې د رینا ډیکټر لخوا د ماشین زده کړې په برخه کې وکارول شوه؛ په یوه مقاله کې چې د زده کړې په وخت کې د محدودیت - اطمینان - ستونزو کې لټون کول ، هغه دا کلمه د داسې پروسې لپاره کارولې چې ټول حلونه یې د لټون ځای کې زیرمه شوي و چې سم ځواب ته نه و رسیدلی. د دې خوندي شوي حلونو تحلیل به په راتلونکو هڅو کې د ښه کنټرول لپاره اجازه ورکړي، په دې توګه په لومړیو مرحلو کې د ممکنه خنډونو مخه نیسي. په هرصورت، نن ورځ د ژورې زده کړې اصطلاح عموما د مصنوعي عصبي شبکو په ساحه کې کارول کیږي، کوم چې په لومړي ځل په 2000 کې د ایګور ایزنبرګ او همکارانو لخوا په پورته ذکر شوي ساحه کې کارول کیږي؛ په ډیر دقیق ډول، په کتاب کې د څو ارزښت لرونکي او یونیورسل بائنري نیورون: تیوري، زده کړه او غوښتنلیکونه او د بولین حد نیورونونو په ساحه کې. [۱۳] [۱۴] په 1989 کې، جان لیکان او ال د لاس لیکل شوي متنونو پیژندلو لپاره (په ځانګړې توګه، په پوستي لیکونو کې د لاسي لیکل شوي پوستي کوډونو پیژندلو هدف لپاره) په ژورې عصبي شبکې کې معیاري بیکپروپیګیشن الګوریتم پلي کړ. په داسې حال کې چې الګوريتم کار کاوه، د دې زده کړې عملیات درې ورځو ته اړتیا لري. کارول شوی ماډل د 256 واحدونو (د 16x16 مربع انځور پکسلز) سره د ان پټ پرت څخه جوړ دی، د 10 واحدونو سره د محصول پرت (کوم چې دا مالومه کړه چې د 0 څخه تر 9 پورې کوم عدد د ان پټ ته ورکړل شوی ډیجیټل عکس دی) او درې پټ پرتونه. دا د دواړو تر منځ جوړ شو. د ازموینې ډیټا سیټ کې د ماډل په ارزولو سره، د پاتې ازموینې نمونو په مینځ کې د 1.8٪ غلط طبقه بندي او 4.4٪ یادونه د 1٪ غلطۍ نرخ لپاره ترلاسه شوي، کوم چې دا ښودلې چې دا ماډل د مخکینیو وړاندې شوي ماډلونو په پرتله خورا درست دی او د بیک پروپیګیشن الګوریتم کارول دي. د ژورو عصبي شبکو د روزنې په بهیر کې مناسب میتود. [۱۵] دا بايد وويل شي چې د شاخپرېدو الګوریتم پخپله د 1970 څخه دمخه او وروسته د اتوماتیک مشتق د متضاد حالت په توګه شتون درلود. [۱۶] [۱۷] تر 1991 پورې، دا ډول سیسټمونه په عمومي ډول د دوه اړخیزو لاسي لیکلو عددونو په جلا کولو کې د پیژندلو لپاره کارول کیده (په دې معنی چې عددونه یوازې لیکل شوي او په شالید کې د اضافي توضیحاتو او ځانګړتیاو پرته، لکه متن او وړاندیزونه )؛ پداسې حال کې چې د درې اړخیزو شیانو پیژندل لاهم یوه ننګونه وه. په 1992 کې، د جان وینګ او همکارانو لخوا یوې څیړنې د درې پرتی عصبي شبکو نیمګړتیاوې او محدودیتونه تشریح کړل چې د دې هدف لپاره کارول شوي، د هییررکیکل شبکې مفهوم یې کارولی او د کریسیپټرون په نوم یې یو ماډل وړاندې کړ، چې د ګڼې ګوڼې په چاپیریال کې د 3D شیانو پیژندلو توان لري. . [۱۸] [۱۹] [۲۰] په دې څیړنه کې د لومړي ځل لپاره د اعظمي پولینګ مفهوم (په انګلیسي کې: max pooling) هم پلي شو. [ ] دا ماډل کولی شي مستقیم طبیعي انځورونه ترلاسه کړي (3D توکي، په شالید کې د نورو عناصرو سره) د ان پټ په توګه، دا د عمومي هدف بصری زده کړې بنسټ شو. په 1994 کې، انډري ډي کاروالو، د مایک فیر هورسټ او ډیویډ بسیټ سره، د څو اړخيزه بولين عصبي شبکې پر بنسټ د جوړښت وړاندیز وکړ، چې د وزن پرته عصبي شبکې په نوم هم ياديږي. دا جوړښت د درې پرتونو ځان تنظیم کولو ځانګړتیا استخراج عصبي شبکې ماډل (په انګلیسي کې: د ځان تنظیم کولو فیچر استخراج یا SOFT) سره د ډلبندۍ ملټي لییر عصبي شبکې ماډل (په ځانګړې توګه د GSN یا هدف لټون شبکې جوړښت سره) ، کوم چې دوی په خپلواکه توګه د زده کړې عمليات ترسره کړي. د فیچر استخراج ماډل کې، د انپټ عکس په څو فرعي برخو ویشل شوی و او هره برخه د نیورونونو بلاک ته ورکړل شوې وه (کوم چې یو ترتیب لري او په څو پرتونو وېشل شوي) او هر بلاک د نورو بلاکونو سره موازي او په خپلواکه توګه روزل شوی و. [۲۱] [۲۲] په 1995 کې، جوزف زیپ هوچریټر ، چې مخکې او په 1991 کې یې په خپله مقاله کې چې عنوان یې و: په متحرک عصبي شبکو کې څیړنې (په آلمان کې : Untersuchungen zu dynamische neuronalen Netzen) - د تدریجي کمیدو ستونزه وڅیړله [۲۳] او دا پخپله وه. په 1847 کې وړاندیز شوی [۲۴] او په 1944 کې د غیر خطي اصلاح کولو ستونزو لپاره مطالعه شوی و ) د جورجین شمیدوبر سره یوځای ، هغه د LSTM جوړښت وړاندې کړ [۲۵] او په 1997 کې یې په یوه بله مقاله کې اصلاح کړ [۲۶] کوم چې د 1997 لپاره لوی بنسټ چمتو کړ. د تکراري عصبي شبکو پراختیا [ حوالې ته اړتیا ده ] په ورته 1995 کې، برینډن فری د جیفري هینټون او پیټر دیان سره وښودله چې دا ممکنه ده چې د ویک-سلیپ الګوریتم په کارولو سره د څو سوو پټ پروسس کولو واحدونو سره د شپږ بشپړ تړل شوي پرتونو څخه جوړه شبکه وروزل شي. [۲۷] حوالې[سمول]مخکې له دې چې د ژورې زده کړې پیل شي، د ماشین زده کړې دودیز میتودونه د ډیټا څخه ترلاسه شوي نمایشونو (د ځانګړتیاوو انتخاب) پورې اړه لري. دا میتودونه د ډومین متخصص ته اړتیا لري ترڅو د فیچر استخراج په لاسي ډول ترسره کړي. په هرصورت، د دې لاسي ځانګړتیا استخراج یوه ننګونه او د وخت اخیستلو پروسه ده. د ژورې زده کړې رامینځته کیدل کولی شي په چټکۍ سره دا دودیز میتودونه ځای په ځای کړي. ځکه چې دا کولی شي په اتوماتيک ډول د هرې ستونزې سره سم ځانګړتیاوې استخراج کړي. [۲۸] پېژندنه[سمول]پداسې حال کې چې په تیرو لسیزو کې د ژورې زده کړې ماډلونه د عکسونو، وینا یا ویډیو په بڼه د ان پټ سره معامله کولو کې بریالي شوي چې اساس یې د یوکلیډین جوړښت دی، پدې وروستیو کې، د څیړونکو لیوالتیا په غیر اکلیډین ډیټا کې د زده کړې پلي کولو هڅه کې زیاتوالی موندلی. جیومیټریک ژوره زده کړه د څیړنې یوه راڅرګنده شوې ساحه ده چې د دې تشې ډکولو لپاره د غیر یوکلیډین ډیټا سره کار کولو لپاره د ژورې زده کړې معمارۍ عمومي کولو هڅه کوي. [۲۹] ګراف عصبي شبکه[سمول]د ګراف عصبي شبکې د ژورې زده کړې میتودونو ټولګي دي چې په ځانګړي ډول د ګرافونو لخوا بیان شوي ډیټا په اړه انعکاس رامینځته کولو لپاره ډیزاین شوي. دا خورا مطلوب دی چې ماډلونه رامینځته کړئ چې مستقیم په ګرافونو کې کار کوي. ځکه، موږ کولی شو د دوی د جوړښت او ځانګړتیاوو په اړه نور معلومات ترلاسه کړو. د ګراف عصبي شبکې مستقیم په ګرافونو کې پلي کیږي او د دندو ترسره کولو لپاره اسانه لار چمتو کوي لکه نوډ ، څنډه ، او د ګراف کچې وړاندوینې. د ګراف عصبي شبکو د پراختیا دمخه، د ژورې زده کړې میتودونه د پوهې استخراج او وړاندوینې په لور د څنډو د پلي کولو وړتیا نه درلوده. پرځای یې، دوی یوازې د نوډ ملکیتونو باندې کار کاوه. [۳۰] د ژورې زده کړې د شهرت لامل[سمول]کمپيوټري لید[سمول]

کينډۍ:پانویس

د ژورې زده کړې لپاره یو له لومړنیو بریالیو ساحو څخه چې د عکس پیژندنې په برخه کې د ستونزو په حل کې د دې میتود احتمالي وړتیا ښودلې.

له 2010 راهیسې، په یوه پروژه کې چې د Imagenet په نوم پیژندل کیږي، کلنۍ سیالي ترسره کیږي چې ګډونوال هڅه کوي د مختلف کمپیوټر الګوریتمونو په وړاندې کولو سره د لوی پیمانه ډیجیټل انځورونه وپیژني او د لوړ دقت ترلاسه کولو لپاره یو بل سره سیالي وکړي. اوس، په 2012 کې، په دې سیالۍ کې د الیکسنیټ په نوم یو عصبي شبکه کارول شوې وه، او د خورا اغیزمنو پایلو په ترلاسه کولو سره یې د ژورې زده کړې میتود ته پراخه پاملرنه راجلب کړه؛ په هغه طریقه چې ځینې باور لري، "ژور زده کړې انقلاب" سږکال ترسره شو. دا باید یادونه وشي چې د امیجنټ ډیټابیس د عکسونو په پیژندلو کې د الیکسنیټ دقت د انسانانو له دقت څخه ډیر و (که څه هم البته ، حتی د الیکسنیټ له وړاندې کولو دمخه ، نورو الګوریتمونو عالي انساني فعالیت ترلاسه کړی و). [۱] [۲] حتی نن ورځ، عصبي شبکې د کمپیوټر لید کې کلیدي رول لوبوي او د مختلفو موخو لپاره کارول کیږي لکه د عکس پیژندنه، د مخ پیژندنه، د څیز تعقیب، شور لرې کول، د تور او سپینو انځورونو رنګ کول، د خراب شوي انځورونو ترمیم، د طبي انځورونو طبقه بندي کول ، او داسې نور. [۳] د وینا خپلکارې پېژندنه[سمول]

کينډۍ:پانویس

د ژورې زده کړې لپاره بله بریالۍ ساحه د لوی پیمانه اتوماتیک وینا پیژندنه ده، کوم چې معمولا د ماډلونو لخوا د تکراري عصبي شبکو (په ځانګړې توګه LSM ) او د عصبي عصبي شبکو پراساس ترسره کیږي. [۱]

د طبیعي ژبې پروسس کول[سمول]ژورې زده کړې د طبیعي ژبې پروسس کولو ساحې په پراختیا کې خورا ښه اغیزه کړې او د ځواکمن ماډل کولو چوکاټ رامینځته کولو سره یې اغیزمنې پایلې ترلاسه کړې. د مثال په توګه، د OpenAI د GPT-3 ژبې ماډل د دې وړتیا لري چې د ژورې زده کړې میتودونو په کارولو سره د انسانانو لخوا لیکل شوي متنونو ته ورته متنونه تولید کړي. [۲] د الکترومیوګرافي تشخیص[سمول]د الکترومیوګرافي سیګنالونه کولی شي د انسان او ماشین ترمینځ د انٹرفیس په توګه عمل وکړي او د دوی تحلیل کولو سره د مختلف تجهیزاتو کنټرول لپاره د کارونکي ارادې څخه ګټه پورته کړي. د بېلګې په توګه، شړل شوي غړي کولی شي مصنوعي پښې وکاروي ترڅو د خپلو مات شوي غړو ځای په ځای کړي او په مؤثره توګه یې کنټرول کړي. یا په ورته طریقه سره، مرستندویه او تقویه کونکي غړي لکه بهرنۍ کنکال کنټرول کیدی شي. د دې خام سیګنالونو تحلیل او د وسیلې کنټرول لپاره مناسب محصول چمتو کولو لپاره ، د ژورې زده کړې میتود کارول خورا ګټور کیدی شي. [۳] د سپارښتنې سیسټم[سمول]وړاندیز کونکي سیسټمونه د موسیقۍ او مجلې د منځپانګې پر بنسټ سپارښتنو لپاره د پټ فکتور ماډل لپاره د معنی وړ ځانګړتیاوو استخراج لپاره ژورې زده کړې کارولي دي. [۴] [۵] ملټي لید ژور زده کړه (په انګلیسي کې: multi-view deep learning) د څو ډومینونو څخه د کاروونکو غوره توبونو زده کولو لپاره کارول کیږي. [۶] پانګه اچونه[سمول]د پانګې اچونې په پالنونو کې، ژورې زده کړې د بیرته راستنیدو نرخ زیاتولو لپاره کارول کیږي. [۷] نن ورځ، ګوګل او ټیسلا ثابته کړې چې بې چلوونکي یا پخپله موټر چلول ممکن دي. په هرصورت، دا باید وویل شي چې دا موټرونه لاهم زده کړې او مختلف تمرینونو او ازموینو ته اړتیا لري، او ډیری فعالیتونه او تغیرات باید وڅیړل شي. غږ پیژندنه د ژبې د پروسې یوه نه بیلیدونکې برخه ده. د آخذې غږ تحلیل د مصنوعي استخباراتو سیسټم لپاره خورا ستونزمن دی؛ ځکه چې ډیری فکتورونه د سم غږ پیژندلو کې رول لوبوي. د مثال په توګه، د شاليد شور، تلفظ، خلاقيت او د خلکو د ژبې لوبې، او همدارنګه د ځانګړو ويناوو معلوليت او نور عوامل دا ستونزمن کوي چې په غږ کې کارول شوي ټکي په سمه توګه په هغه څه کې توپیر وکړي چې کمپیوټر یې تحلیل کولی شي. د "ژورې زده کړې" شبکې کارول کولی شي په ډیری سافټویر کې د کارونکي لخوا کارول شوي نمونې په پیژندلو سره د خدماتو وړاندې کولو کیفیت لوړ کړي. یو ښه مطابقت لرونکی AI کولی شي غیر اړونده معلومات له پامه غورځوي او کارونکي ته اړوند معلومات چمتو کړي. د نمونې پیژندنه کولی شي د لوی معلوماتو تحلیل ډیر اغیزمن کړي. کمزوري مصنوعي هوښیارتیا د معنی لرونکي متن تولید او د کوډ کولو په برخه کې پرمختګونو کې بریاوې لري. د مثال په توګه، د OpenAI څخه GPT-3 د خلاصې سرچینې سافټویر جوړونکي ژبه ده چې کولی شي د کارونکي څخه لږ تر لږه لارښوونې سره ساده کمپیوټر پروګرامونه کوډ یا جوړ کړي. په راتلونکي کې، موږ به شاید د نورو سافټویر شتون وګورو چې د دې ډول ټیکنالوژۍ څخه ګټه پورته کوي، او د ځانګړي سافټویر سره کار کول به یو بل رنګ واخلي. مصنوعي استخبارات به د سازمانونو، افرادو او حکومتونو د سایبر امنیت اقداماتو کې خورا مهم رول ولوبوي، چې پدې کې به څارنه، د معلوماتو ګواښونو پیژندنه، د امنیتي لاسوهنو خبرتیا، د پیښو غبرګون او د خطر تحلیل شامل وي. AI لاهم کولی شي حکومتونو ته د څارنې ځواکمن وسیلې چمتو کړي ترڅو په اسانۍ سره خپل مخالفین وپیژني. د کمپیوټر پروګرامونه د منځپانګې په جوړولو کې ورځ تر بلې ښه کیږي، او مصنوعي هوښیارتیا اوس د کاپي رایټ څخه د سرغړونې د پیښو په پیژندلو، ویډیو ګیمونو او فلمونو جوړولو کې هم مهم رول لوبوي، او دا رول به په راتلونکي کې نور هم لوړ شي. مفهوم[سمول]ژورې عصبي شبکې (DNNs) د کمپیوټري پلوه د زده کړې ماډلونه دي. دا ماډلونه په مختلفو سکټورونو کې زیاتیدونکي غوښتنلیکونه لري. ځکه چې FPGAs د محاسبې ګړندي کولو لپاره د برنامه وړ زیربنا چمتو کوي او نن ورځ د نړۍ په ډیری برخو کې په اسانۍ سره شتون لري ، FPGAs د DNN ماډلونو پلي کولو لپاره خورا ښه انتخاب دی. مګر د FPGAs کارول خورا ستونزمن دي چې په ورته وخت کې د دوی موثریت او ټیټ انرژي مصرف ترلاسه کړي ، او همدارنګه DNNs ډیری حافظې ته اړتیا لري (د بورډ حافظه معمولا په FPGAs کې کوچنۍ وي) ، د FPGAs سره ماډل پلي کول خورا ستونزمن دي. د عصبي شبکې ویور (DNNWEAVER) یو چوکاټ دی چې په اتوماتيک ډول د ترتیب شوي جوړه (DNN، FPGA) لپاره د ترکیب وړ کوډ رامینځته کوي. د DNN ماډل د ان پټ په توګه ورکول کیږي ځکه چې دا په کیف کې معرفي شوی. د دې برنامې عمومي کاري پروسه دا ده چې دا لومړی د ان پټ ماډل په منځمهاله ژبه بدلوي چې د ټولیز ډیټا جریان ګراف ښیې. پدې مرحله کې، دا ورکړل شوي ماډل د مختلف الګوریتمونو سره ګروپ کوي ترڅو د معلوماتو اعظمي بیا کارولو او د FPGA حافظې او نورو سرچینو سره سم د موثریت لوړې کچې ترلاسه کړي چې په FPGA کې شتون لري. له هغې وروسته، وروستۍ پایله د ترکیب وړ کوډ دی چې د ان پټ ماډل ټولې اړتیاوې په مطلوب FPGA کې د لوړې موثریت سره پوره کوي. غوښتنلیکونه[سمول]دا په ژورو عصبي شبکو کې د FPGAs کارولو لپاره اړین اوږد دورې وخت لنډولو کې مرسته کوي. د دې کار هدف دا دی چې یو اتوماتیک چوکاټ تولید کړي چې لومړی پروګرامر د هارډویر ډیزاین او اصلاح کولو توضیحاتو څخه جلا کوي. دوهم، چوکاټ پخپله په FPGA کې موجود محدودو سرچینو سره مبارزه کوي؛ او په نهایت کې ، دا د FPGA لپاره یو باثباته چوکاټ چمتو کوي ، کوم چې په مختلف FPGAs کې د ژور عصبي شبکو مختلف ماډلونو پلي کولو لپاره لوړ فعالیت چمتو کوي. DNNWEAVER د ورته اهدافو ترلاسه کولو لپاره ډیزاین شوی. په لومړي ګام کې، DNNWEAVER د ژور عصبي شبکې ماډل ته اړتیا لري چې د لوړې کچې انٹرفیس په کارولو سره مشخص شوی. د ماډلینګ انٹرفیس[سمول]د DNNWEAVER برنامه ان پټ د ژور عصبي شبکو د لوړې کچې توضیح کوونکی دی چې د برکلي په پوهنتون کې د کیف فارمیټ لاندې رامینځته شوی [۱۴] . کیف یو له خورا پراخه کارول شوي ژورې زده کړې چوکاټونو څخه دی چې د شبکې توضیحات د ان پټ په توګه اخلي او په CPU یا GPU کې یې د اجرا وړ ماډل ته بدلوي. DNNWEAVER په اوتومات ډول د ان پټ ماډل د ویریلوګ ترکیب وړ کوډ ته بدلوي. DNNWEAVER د سافټویر څلور برخې لري:

ژباړن[سمول]ژباړونکی تشریح شوی ژوره شبکه په یو ځانګړي لارښود سیټ جوړښت کې بدلوي چې د معلوماتو لاره تعریفوي. په دې سیټ کې هر کمانډ د شبکې ډیټا لار ګراف کې د نوډ استازیتوب کوي. په یاد ولرئ چې FPGA مستقیم دا لارښوونې نه پلي کوي. د DNNWEAVER کمپیلر دا قوماندې د FPGA کنټرول سیګنالونو ته نقشه کوي او د اجرا کولو مهالویش رامینځته کوي. دا میتود یو مدغم سافټویر - هارډویر انٹرفیس چمتو کوي؛ له همدې امله ، د دې جوړښت په مرسته ، د لارښوونې سیټ د سرعت پلي کولو مختلف ډولونه وړوي چې د هدف FPGA محدودیتونو سره مطابقت لري. د ډیزاین مسوده[سمول]د ډیزاین نقشه کونکي په تیرو مرحلو کې رامینځته شوي کمانډونه د ان پټ په توګه اخلي او د منزل FPGA لپاره هارډویر ټیمپلیټونه د نمونې سرچینې اصلاح کولو الګوریتم په مرسته اصلاح کوي. نقشه کوونکی د هرې طبقې د محاسبې پلان د آپریټرانو په ګروپونو ویشي چې ډاټا شریکوي یا بیا کاروي. موږ د دې هرې برخې ټوټې بولو. د محاسبې څخه وروسته هره ټوټه په حافظه کې ډوب کیږي او FPGA د راتلونکي ټوټه محاسبه کولو ته ځي. د عصبي شبکې سرعت کوونکی د FPGA د ټیټ حافظې په مقابل کې د اړتیا وړ حافظې لوی مقدار سره اساسي ستونزه لري ، کوم چې DNNWEAVER دا ستونزه د ټیمپلیټ سرچینې اصلاح کولو الګوریتم په کارولو سره ښه کوي ، او د دې په مرسته د موازي آپریټرانو او ډیټا ترمینځ توازن رامینځته کوي. بیا کارول د منزل FPGA محدودیتونو سره سم رامینځته کیږي. هغه کوي. ډیزاین اوبدل[سمول]ډیزاین اوبدل د DNNWEAVER وروستی پاتې مرحله ده، چې د اړتیا وړ سرچینو مقدار او د اجرا کولو کليز په تیر مرحله کې تولید شوی، او د هغې په مرسته، دا د سرعت کور تولیدوي. DNNWEAVER یو شمیر د لاسي اصلاح کولو ټیمپلیټونه کاروي چې په تیر مرحله کې رامینځته شوي د سرچینو نیول او د هارډویر تنظیم په پام کې نیسي. ادغام کوونکی[سمول]د DNNWEAVER وروستۍ برخه ادغام کوونکی دی. پدې مرحله کې ، د حافظې انٹرفیس کوډونه د سرعت کوډونو کې اضافه شوي. څنګه چې مختلف FPGAs د بهرني DRAM سره د خبرو اترو لپاره مختلف انٹرفیسونه کاروي ، پدې برخه کې د DRAM انٹرفیس کتابتونونه شامل دي چې هر ځل اړین کوډ اضافه کوي. نور اړوند کارونه[سمول]د کار په دې ډګر کې، د بېلابېلو موخو سره هارډویرونه جوړ شوي. که څه هم DNNWEAVER سرعت کوونکی ندی، دا د سرعت کوډ جنریټر دی. تابلا [۱۵] د ماشین زده کړې الګوریتم روزنې مرحلې لپاره د FPGA سرعت چمتو کوي پداسې حال کې چې DNNWEAVER د عصبي شبکې مخبڼې باندې تمرکز کوي. تابلا خپله رياضيکي ژبه کاروي، پداسې حال کې چې DNNWEAVER د ماډل مشخص کولو لپاره کیف کاروي. د چین او ال [۱۶] له خوا د لاين ماډل په تحليلي سکيم کې ترسره شوی کار په FPGA کې د ورته ژور عصبي شبکې لپاره ترټولو ګړندۍ سکیم موندلو لپاره ترټولو کارول کیږي. مګر پدې کې ځینې پرتونه شامل ندي لکه حوض کول.

هندسي ژوره زده کړه[سمول]د عصبي شبکو یوه عمومي کتنه[سمول]

|

- ↑ Kim, John (2018-09-02). "Emotion Recognition from Human Speech Using Temporal Information and Deep Learning". Interspeech 2018. doi:10.21437/interspeech.2018-1132. منځګړی

|CitationClass=له پامه غورځول شوی (لارښود) - ↑ کينډۍ:یادکرد وب

- ↑ Jafarzadeh, M.; Hussey, D. C.; Tadesse, Y. (2019-09). "Deep learning approach to control of prosthetic hands with electromyography signals". 2019 IEEE International Symposium on Measurement and Control in Robotics (ISMCR): A1–4–1-A1-4-11. doi:10.1109/ISMCR47492.2019.8955725. منځګړی

|CitationClass=له پامه غورځول شوی (لارښود); تحقق من التاريخ في:|date=(لارښود) - ↑ van den Oord, Aäron; Dieleman, Sander; Schrauwen, Benjamin (2013-03-14). "Learning a piecewise linear transform coding scheme for images". International Conference on Graphic and Image Processing (ICGIP 2012). SPIE. doi:10.1117/12.2011134. منځګړی

|CitationClass=له پامه غورځول شوی (لارښود) - ↑ Feng, Xiaoyue; Zhang, Hao; Ren, Yijie; Shang, Penghui; Zhu, Yi; Liang, Yanchun; Guan, Renchu; Xu, Dong (2019). "The Deep Learning–Based Recommender System "Pubmender" for Choosing a Biomedical Publication Venue: Development and Validation Study". Journal of Medical Internet Research (په انګليسي ). 21 (5): e12957. doi:10.2196/12957. PMC 6555124. PMID 31127715. منځګړی

|CitationClass=له پامه غورځول شوی (لارښود)ساتنه CS1: بڼه PMC (link) - ↑ Elkahky, Ali Mamdouh; Song, Yang; He, Xiaodong (2015). "A Multi-View Deep Learning Approach for Cross Domain User Modeling in Recommendation Systems". Proceedings of the 24th International Conference on World Wide Web - WWW '15. New York, New York, USA: ACM Press. doi:10.1145/2736277.2741667. د کتاب نړيواله کره شمېره 978-1-4503-3469-3. منځګړی

|CitationClass=له پامه غورځول شوی (لارښود) - ↑ کينډۍ:یادکرد ژورنال

- ↑ کينډۍ:یادکرد وب

- ↑ کينډۍ:یادکرد وب

- ↑ کينډۍ:یادکرد وب

- ↑ کينډۍ:یادکرد وب

- ↑ کينډۍ:یادکرد وب

- ↑ کينډۍ:یادکرد وب

- ↑ Yangqing Jia, Evan Shelhamer, Jeff Donahue, Sergey Karayev, Jonathan Long, Ross Girshick, Sergio Guadarrama, and Trevor Darrell. Caffe: Convolutional architecture for fast feature embedding. arXiv preprint

- ↑ Divya Mahajan, Jongse Park, Emmanuel Amaro, Hardik Sharma, Amir Yazdanbakhsh, Joon Kyung Kim, and Hadi Esmaeilzadeh. Tabla: A unified template-based framework for accelerating statistical machine

- ↑ Chen Zhang, Peng Li, Guangyu Sun, Yijin Guan, Bingjun Xiao, and Jason Cong. Optimizing fpga-based accelerator design for deep convolutional neural networks. In FPGA, 2015.